在当今快速发展的科技环境中,人工智能(AI)的应用范围不断扩大,几乎渗透到了我们生活的各个领域。然而,随着AI技术的广泛应用,如何有效管理和监控这些系统,成为了相关领域研究的一个重要课题。在这篇文章中,我将探讨如何设计一个高效的人工智能管理体系,确保其在实际应用中既遵循伦理标准,又能优化性能。

什么是人工智能管理体系?

人工智能管理体系是指一种系统性的结构和规范,用于保障人工智能系统的安全性、透明度和责任性。这一体系涉及多方面的内容,包括:

- 政策制定:确保管理措施与现行法律和行业标准相符。

- 风险评估:定期评估实现AI技术可能带来的风险,包括数据安全、算法偏见等。

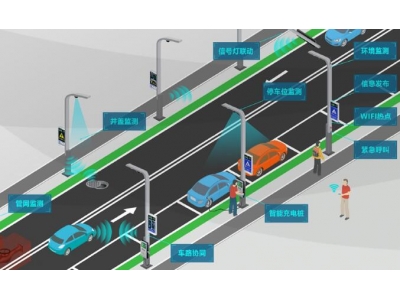

- 性能监控:确保AI系统良好运转,通过实时反馈识别并解决性能问题。

- 伦理监督:确保AI应用符合社会伦理和企业社会责任。

设计人工智能管理体系的步骤

在设计有效的人工智能管理体系时,我认为可以遵循几个关键步骤:

1. 确定管理目标

首先,需要明确管理的核心目标。这包括保障用户隐私、提高系统安全性、优化算法性能等。确定目标可以为后续的策略制定提供方向。

2. 建立政策框架

依据确定的管理目标,建立一个政策框架。这个框架应涵盖所有涉及的法律法规以及行业标准,并结合公司自主规定。此阶段需要跨领域专家的参与,确保政策的全面性和可执行性。

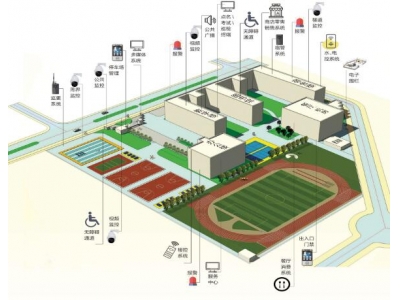

3. 实施技术监控手段

我认为,实施技术手段是确保AI系统运行的重要环节。需要建立可靠的监控平台,对AI算法的运行进行定期检查,并不断更新监控技术,以适应发展的需求。

4. 定期评估与优化

在AI管理体系实施后,我必须定期进行评估与优化。这包括收集反馈、分析使用数据,评估算法的公正性和有效性。同时,要通过调查问卷、用户访谈等形式收集用户反馈信息,不断调整和完善管理措施。

挑战与对策

在实施人工智能管理体系的过程中,我遇到了许多挑战。

1. 数据隐私问题

在处理与用户相关的数据时,数据隐私始终是焦点。应制定明确的数据使用政策,确保用户在知情的情况下同意数据的使用。此外,考虑加密技术,保护敏感信息不被滥用。

2. 算法偏见

算法的偏见问题同样困扰着我们。为了缓解这种情况,我主张在算法开发的早期就引入多样化的数据集,确保训练的公正性。同时,定期审视和评估算法的决策过程,发现和消除潜在的偏见。

3. 伦理责任问题

伦理责任问题是任何人工智能应用不可回避的难题。作为管理者,我认为企业应明确AI应用中的伦理责任,定期举办伦理培训,增强团队的道德意识,从源头上降低伦理争议的风险。

案例研究

为了更好地理解如何构建一个有效的人工智能管理体系,我将分享一些成功的案例:

案例一:银行业人工智能风险管理

某大型银行在应用人工智能风控系统之初,制定了全面的内部政策,明确了数据使用、算法审核及伦理责任的比例。此外,他们还引入了专门的伦理委员会,持续监控AI技术在风险管理中的应用,确保其合规性和透明度。

案例二:医疗健康领域的AI治理

在医疗健康领域,一家知名医院使用人工智能辅助诊断。在设计AI管理体系时,他们注重患者隐私的保护,采取了严格的数据加密措施,并定期对人工智能的决策逻辑进行审核。同时,医院积极与患者沟通,确保患者理解AI诊断的过程和依据,提高了患者对AI系统的信任度。

展望未来的人工智能管理

随着人工智能技术的不断发展,人工智能管理体系的设计将不仅仅限于政策和技术的结合,还需考虑社会影响与公众参与。我相信,在未来,我们将看到更多跨行业的合作,共同探索和制定更加完善的管理框架。

这篇文章希望能够为大家提供关于人工智能管理体系设计的一些指导和灵感,从而使AI技术在各行各业中得以更为安全和高效的应用。如果你对人工智能管理、伦理责任或是风险管理有更深入的兴趣,不妨继续探索相关文献和实际案例,为自己的设计提供更全面的视野。