在当今社会,人工智能(AI)迅速发展并渗透到各个领域。然而,随着技术的进步,反乌托邦式的人工智能观念逐渐浮出水面。与其说反乌托邦是一个科幻概念,不如说它是对人类未来现实的深思与警示。这篇文章将探讨反乌托邦式人工智能的表现、潜在危机以及我们应如何应对。

反乌托邦式人工智能的定义

反乌托邦(Dystopia)是指一个看来完美但实际上极为糟糕的社会。反乌托邦式的人工智能则是指那些应用和发展人工智能技术所导致的负面效果。例如,通过操控、监视、算法歧视等手段,人工智能可能会侵犯个体自由,助长社会不平等,最终形成一个失去人性的社会。

反乌托邦式人工智能的表现

反乌托邦式人工智能的表现主要体现在以下几个方面:

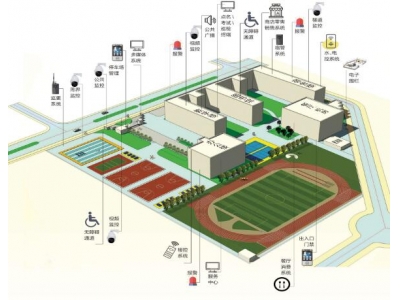

- 监控社会:某些国家和企业利用人工智能进行大规模监控,通过人脸识别、行为分析等手段监视公民的日常生活,削弱个体隐私和自由。

- 算法偏见:人工智能系统往往基于历史数据进行学习,而这些数据可能反映了社会中的偏见,导致特定群体在决策中被边缘化。

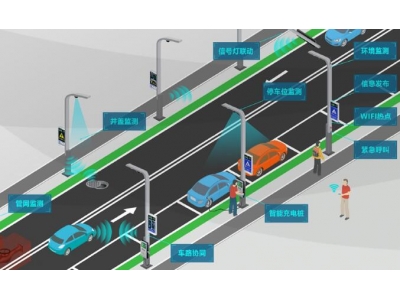

- 失控的自动化:随着越来越多的工作由人工智能取代,社会中出现了大规模失业和经济不平等,造成了人类与机器的对立。

- 伦理和道德困境:人工智能被应用于军事和其他敏感领域,导致对生命的简单计算,缺乏基本的人道主义保护。

反乌托邦式人工智能的潜在危机

反乌托邦式人工智能带来的危机不仅是技术层面的,更是文化和社会层面的。具体危机主要体现在以下几个方面:

- 人权的侵蚀:技术的滥用可能会侵犯基本人权,导致压制言论、集会和宗教自由等现象。

- 社会分裂与冲突:由于智能算法的偏见,不同群体之间可能会产生更大的误解与冲突,社会的团结受到威胁。

- 道德沦丧:如果社会对技术的依赖程度过高,可能导致人类忽视道德和伦理,造成人性缺失。

- 经济的不平等:富者更富、贫者更贫的局面愈发严重,扩大了社会阶层之间的鸿沟。

如何应对反乌托邦式人工智能

面对这种潜在危机,人类应该采取积极措施,以确保人工智能技术的健康发展:

- 制定法律法规:各国政府需要通过立法保护公民的基本权利,同时对人工智能的研发与应用进行监督。

- 加强伦理教育:从技术人员到决策者都应接受伦理教育,确保在人工智能的开发与应用中注入人文关怀。

- 促进技术透明性:确保人工智能算法的公开与透明,以减少歧视和偏见。

- 鼓励多元审视:吸纳不同背景、不同观点的专家进行合作,减少单一视角对技术发展的影响。

结论

反乌托邦式人工智能警示我们,不应盲目追求技术进步,而应深思其对人性的影响。只有理解其潜在危机并采取相应措施,我们才能在享受人工智能带来的便利的同时,更好地保护我们的自由和权利。

感谢您阅读这篇文章!希望通过这篇文章,您能更深入地理解反乌托邦式人工智能的影响和危机,以及如何应对这一挑战。